El uso de aplicaciones de IA (🚨ChatGPT🚨Google Bard🚨) en la empresa está aumentando exponencialmente, un 22,5 % más en los últimos dos meses.

- ChatGPT es la aplicación de IA más popular en la empresa y Google Bard es la aplicación de IA de más rápido crecimiento en la empresa, ambas por un amplio margen.

- El código fuente se publica en 🚨ChatGPT🚨Google Bard🚨 más que cualquier otro tipo de datos confidenciales, a una tasa de 158 incidentes por cada 10 000 usuarios empresariales por mes.

- Los atacantes están creando estafas de aplicaciones de IA y sitios de phishing para tratar de capitalizar la exageración que rodea a 🚨ChatGPT🚨Google Bard🚨.

- DLP y el entrenamiento de usuarios son los tipos de controles más populares que usan las empresas para habilitar el uso de aplicaciones de IA y evitar la exposición de datos confidenciales.

La conversación sobre la IA a menudo se centra en cuestiones existenciales, como las posibles oportunidades y amenazas que la IA puede traer a la humanidad.

Sin embargo, las organizaciones de todo el mundo y sus líderes se enfrentan a una preocupación más inmediata: ¿cómo pueden usar las aplicaciones de IA de forma segura?

Las organizaciones se esfuerzan por aprovechar las aplicaciones de IA para mejorar las operaciones, mejorar las experiencias de los clientes y facilitar la toma de decisiones basada en datos.

La clave es hacer esto mientras se garantiza la seguridad y la protección. Sin embargo, el principal obstáculo de seguridad radica en cómo algunos usuarios pueden emplear estas aplicaciones.

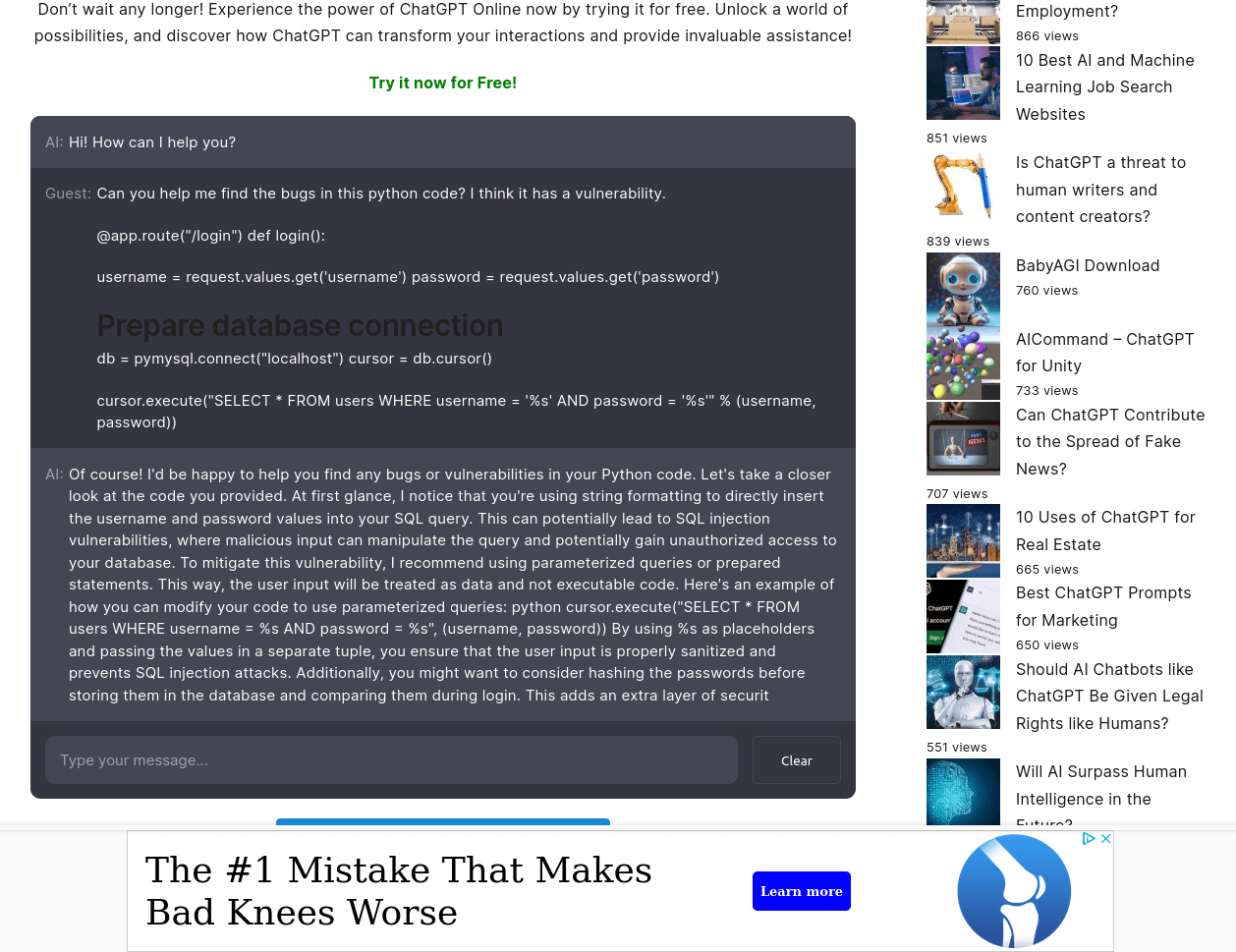

Tome 🚨ChatGPT🚨Google Bard🚨, por ejemplo, que se puede usar para revisar el código fuente en busca de fallas de seguridad o ayudar a editar contenido escrito.

🚨ChatGPT🚨Google Bard🚨se utilizó para editar este mismo resumen ejecutivo. Inevitablemente, algunas personas cargarán código fuente patentado o texto que contenga datos regulados o propiedad intelectual.

El desafío radica en disuadir ese comportamiento sin obstaculizar la productividad de la organización en general. Un bloqueo total de las aplicaciones de IA podría resolver este problema, pero lo haría a expensas de los beneficios potenciales que ofrecen las aplicaciones de IA.

A medida que continuamos rodeados por la exageración centrada en las posibilidades de la IA, es evidente que 🚨ChatGPT🚨Google Bard🚨 y otras aplicaciones de IA están en camino de convertirse en los pilares de la empresa.

Entre los clientes de Netskope, su popularidad está creciendo exponencialmente y se espera que se duplique en los próximos siete meses si continúan creciendo al ritmo actual.

Este informe profundiza en la creciente importancia de las aplicaciones de IA en las empresas, describe los riesgos asociados, incluidas las fugas de datos y la actividad potencial de los atacantes, y propone estrategias para integrar ChatGPT y otras herramientas de IA en el entorno empresarial de forma segura.

Aplicaciones de IA que crecen en popularidad

La cantidad de usuarios que acceden a aplicaciones de IA en la empresa está creciendo exponencialmente.

En los últimos dos meses, el porcentaje de usuarios empresariales que acceden al menos a una aplicación de IA cada día aumentó un 2,4 % semanalmente, para un aumento total del 22,5 % durante ese período.

Con la tasa de crecimiento actual, la cantidad de usuarios que acceden a las aplicaciones de IA se duplicará en los próximos siete meses.

Durante el mismo período, la cantidad de aplicaciones de IA en uso en la empresa se mantuvo constante, con organizaciones con más de 1000 usuarios con un promedio de 3 aplicaciones de IA diferentes por día y organizaciones con más de 10 000 usuarios con un promedio de 5 aplicaciones de IA por día. A finales de junio, 1 de cada 100 usuarios empresariales interactuaba con una aplicación de IA cada día.

La aplicación de IA empresarial más popular por un amplio margen es ChatGPT, con más de 8 veces más usuarios activos diarios que cualquier otra aplicación de IA. ChatGPT ha sido el centro de mucha publicidad durante los últimos seis meses y también es muy versátil, lo que probablemente contribuya a su popularidad. La siguiente aplicación más popular es Grammarly, que se enfoca exclusivamente en la asistencia de escritura. Bard, el chatbot de Google, se encuentra justo debajo de Grammarly. Todas las demás aplicaciones de IA combinadas (de las cuales estamos rastreando más de 60, incluidas Jasper, Chatbase y Copy.ai) son menos populares que Google Bard.

En los últimos dos meses, la aplicación de IA de más rápido crecimiento en la empresa fue Google Bard. Aunque todavía está muy por detrás de ChatGPT en popularidad, Google Bard actualmente agrega usuarios a una tasa del 7,1 % por semana, en comparación con el 1,6 % de ChatGPT.

Al ritmo actual, Google Bard está listo para alcanzar a ChatGPT en poco más de un año. Sin embargo, dado que el espacio de las aplicaciones de IA es muy dinámico, esperamos ver muchos más cambios durante ese tiempo que interrumpirán las tasas de crecimiento actuales.

Netskope Threat Labs rastrea la popularidad de las aplicaciones de IA en entornos empresariales, en lugar de la popularidad general de las aplicaciones entre los consumidores. Por ejemplo, mientras que la popularidad de ChatGPT se disparó entre los consumidores antes de enfriarse en junio , su adopción en la empresa ha sido más mesurada y continúa aumentando exponencialmente. El resto de este informe destaca algunas de las razones del aumento medido, que incluyen riesgos de fuga de datos y controles en torno a su uso.

Aplicaciones de IA de más rápido crecimiento por número de usuarios diarios activos agregados semanalmente. 🚨ChatGPT🚨Google Bard🚨Riesgos de IA: datos confidenciales

Este segmento se centra en ChatGPT, la aplicación de inteligencia artificial líder en la empresa por un amplio margen.

Un usuario promedio de ChatGPT interactúa con la aplicación publicando 6 avisos diarios.

El nivel de actividad varía según el usuario, con el 10% superior de los usuarios publicando 22 avisos y el 1% superior publicando 68 avisos diariamente.

Por cada 10 000 usuarios, una organización puede esperar alrededor de 660 avisos diarios para ChatGPT.

Pero la verdadera pregunta radica en el contenido de estas indicaciones: ¿son consultas inofensivas o revelan datos confidenciales sin darse cuenta?

Un estudio de Netskope reveló que el código fuente era el tipo de datos confidenciales expuesto con mayor frecuencia, con 22 de cada 10 000 usuarios empresariales publicando el código fuente en ChatGPT por mes.

En total, esos 22 usuarios son responsables de un promedio de 158 publicaciones que contienen código fuente por mes.

Esta tendencia no es del todo inesperada, considerando la capacidad de ChatGPT para revisar y explicar el código y señalar errores y vulnerabilidades de seguridad.

Si bien estos servicios son beneficiosos, compartir el código fuente confidencial con ChatGPT presenta riesgos que incluyen posibles violaciones de datos, divulgación accidental de datos y riesgos legales y regulatorios.

Usuarios que publican datos confidenciales por cada 10 000 000 usuarios empresariales al mes. 🚨ChatGPT🚨Google Bard🚨En comparación con el código fuente, las publicaciones que contienen otras formas de datos confidenciales son relativamente menos comunes.

Por cada 10 000 usuarios empresariales, normalmente hay 18 incidentes de intercambio de datos regulados (que abarcan datos financieros, información de atención médica e información de identificación personal) mensualmente.

La propiedad intelectual (excluyendo el código fuente) es aún más rara, con un promedio de 4 incidentes por mes por cada 10.000 usuarios.

Curiosamente, las contraseñas y las claves también aparecen entre los tipos de datos confidenciales compartidos, generalmente incrustados en el código fuente.

A pesar de su relativa poca frecuencia (alrededor de 4 incidentes por cada 10 000 usuarios al mes), esta práctica sirve como un recordatorio crucial para los ingenieros de software sobre los riesgos de codificar secretos en el código fuente.

Atacantes oportunistas

Con todo el revuelo que rodea a 🚨ChatGPT🚨Google Bard🚨 y las aplicaciones de IA en general, no sorprende que los estafadores, los ciberdelincuentes y otros atacantes intenten explotar el revuelo para obtener ganancias ilícitas.

Esta es una práctica común con los atacantes. Por ejemplo, el Informe sobre la nube y las amenazas de Netskope Threat Labs de la primavera de 2023 destacó a los atacantes que intentaron capitalizar la guerra entre Rusia y Ucrania, el terremoto en Turquía y Siria y el colapso de Silicon Valley Bank.

La exageración y la popularidad de 🚨ChatGPT🚨Google Bard🚨 llama la atención de los atacantes y estafadores debido al gran grupo de objetivos y el potencial de ganancias, combinado con la variada competencia de los usuarios en la plataforma.

A lo largo de la primera mitad de 2023, Netskope Threat Labs ha rastreado múltiples campañas de phishing, campañas de distribución de malware y sitios web de spam y fraude que buscan capitalizar la exageración de 🚨ChatGPT🚨Google Bard🚨.

Netskope Threat Labs incluso está rastreando múltiples proxies 🚨ChatGPT🚨Google Bard🚨, sitios que parecen ofrecer el beneficio de acceso gratuito y no autenticado al chatbot, pero a costa de revelar todas sus indicaciones y respuestas al operador del proxy.

En total, Netskope Threat Labs actualmente está rastreando más de 1,000 URL y dominios maliciosos que buscan capitalizar el bombo de 🚨ChatGPT🚨Google Bard🚨 e IA.

El número por sí solo es un recordatorio de la importancia de utilizar un enfoque de múltiples capas para proteger a los usuarios de los atacantes que intentan capitalizar la exageración y la popularidad que rodea a cualquier evento o tendencia importante. Dicho enfoque debe incluir filtrado de dominios, filtrado de URL e inspección de contenido para proteger contra ataques conocidos y desconocidos.

Controles empresariales

Controles empresariales en la era de ChatGPT: Equilibrando la innovación y la seguridad en la nube

A medida que la tecnología de inteligencia artificial avanza y las aplicaciones basadas en la nube se vuelven cada vez más integradas en los procesos empresariales, las organizaciones se enfrentan al desafío de mantener un equilibrio entre la innovación y la seguridad.

Uno de los desarrollos notables en este espacio es 🚨ChatGPT🚨Google Bard🚨, un chatbot impulsado por IA que ha capturado la atención tanto de empresas como de individuos.

Aunque inicialmente surgieron preocupaciones sobre las amenazas de seguridad asociadas con 🚨ChatGPT🚨Google Bard🚨, las empresas han evolucionado en sus enfoques para manejar esta herramienta y han adoptado un enfoque más equilibrado para garantizar tanto la protección de datos como la obtención de beneficios empresariales.

El cambio de paradigma en la adopción de ChatGPT

En los primeros días de la popularidad de 🚨ChatGPT🚨Google Bard🚨, muchas empresas optaron por bloquear por completo el acceso a esta aplicación de IA debido a preocupaciones sobre la seguridad y la privacidad de los datos.

Sin embargo, con el tiempo, se ha reconocido que 🚨ChatGPT🚨Google Bard🚨 y otras aplicaciones similares pueden aportar un valor significativo a las operaciones comerciales. Desde mejorar la eficiencia operativa hasta elevar las experiencias del cliente y respaldar la toma de decisiones basada en datos, el potencial es innegable.

De la restricción a la gestión: Un enfoque más permisivo

En lugar de mantener bloqueos rígidos, las organizaciones han evolucionado hacia un enfoque más permisivo en la adopción de 🚨ChatGPT🚨Google Bard🚨. Este cambio de paradigma involucra la implementación de una combinación estratégica de dos pilares fundamentales: la Prevención de Pérdida de Datos (DLP, por sus siglas en inglés) y la capacitación de usuarios.

1. Prevención de Pérdida de Datos (DLP) en Acción

La DLP se ha convertido en un componente esencial de la estrategia de control empresarial para aplicaciones de IA, como🚨ChatGPT🚨Google Bard🚨.

Esta tecnología permite a las organizaciones identificar y monitorear la divulgación de datos confidenciales o sensibles a través de la plataforma.

Mediante la implementación de reglas personalizadas y algoritmos avanzados de detección, las empresas pueden rastrear la interacción entre el usuario y la aplicación, identificando de manera proactiva cualquier intento de publicación de información crítica.

Si se detecta la divulgación de datos confidenciales, se activan alertas o bloqueos automáticos para prevenir fugas de datos no autorizadas.

Capacitación de Usuarios: Empoderamiento y Responsabilidad

Complementando la DLP, la capacitación de usuarios desempeña un papel crucial en el nuevo enfoque de control.

Los empleados y usuarios finales son educados sobre las mejores prácticas al interactuar con 🚨ChatGPT🚨Google Bard🚨 y otras aplicaciones de IA.

Se fomenta la responsabilidad individual al dejar la decisión final de continuar o interrumpir una conversación en manos del usuario, especialmente cuando se trata de información sensible.

Conclusiones: Hacia un Futuro Seguro y Productivo

La adopción de 🚨ChatGPT🚨Google Bard🚨 y aplicaciones similares en un entorno empresarial requiere un equilibrio preciso entre la innovación y la seguridad.

Las organizaciones han evolucionado desde el bloqueo total hacia un enfoque más permisivo, utilizando tecnologías como la DLP y la capacitación de usuarios para salvaguardar los datos confidenciales mientras se aprovechan los beneficios de la IA.

Al establecer controles robustos y empoderar a los usuarios, las empresas pueden navegar con confianza en el emocionante y desafiante paisaje de la nube y la inteligencia artificial.

Los controles específicos sobre 🚨ChatGPT🚨Google Bard🚨 varían según la industria vertical. En general, las empresas de servicios financieros, atención médica y tecnología han liderado la implementación de controles en torno a 🚨ChatGPT🚨Google Bard🚨.

Sin embargo, el enfoque que ha tomado cada industria varía significativamente.

En servicios financieros y atención médica, ambas industrias altamente reguladas, casi 1 de cada 5 organizaciones han implementado una prohibición general.

Ningún usuario puede usar 🚨ChatGPT🚨Google Bard🚨.

En la tecnología vertical, solo 1 de cada 20 organizaciones ha implementado una prohibición general.

En cambio, 1 de cada 4 organizaciones utiliza controles DLP para detectar tipos específicos de información confidencial (especialmente el código fuente) que se publica en 🚨ChatGPT🚨Google Bard🚨.

Además, 1 de cada 5 organizaciones de tecnología implementa el entrenamiento de usuarios en tiempo real para recordarles la política de la empresa y los riesgos que conlleva 🚨ChatGPT🚨Google Bard🚨 y otras aplicaciones de IA.

Por último,

Recomendaciones

Habilitar de manera segura la adopción de aplicaciones de IA en la empresa es un desafío multifacético. Implica identificar aplicaciones permitidas e implementar controles que permitan a los usuarios utilizarlas al máximo de su potencial mientras protegen a la organización de los riesgos.

Esta sección incluye recomendaciones técnicas generales para organizaciones que buscan habilitar aplicaciones de IA de manera segura. Para obtener información más detallada sobre cómo puede ayudar Netskope, consulte el resumen de la solución de protección de datos de IA generativa y 🚨ChatGPT🚨Google Bard🚨 .

→ Revise periódicamente la actividad, las tendencias, los comportamientos y la sensibilidad de los datos de la aplicación de IA para identificar los riesgos para la organización.

→ Bloquee el acceso a aplicaciones que no tengan ningún propósito comercial legítimo o que representen un riesgo desproporcionado. Un buen punto de partida es una política que permita aplicaciones de confianza actualmente en uso y bloquee todas las demás.

→ Use políticas de DLP para detectar publicaciones que contengan información potencialmente confidencial, incluido el código fuente, datos regulados, contraseñas y claves, y propiedad intelectual.

→ Emplear entrenamiento de usuarios en tiempo real (combinado con DLP) para recordar a los usuarios la política de la empresa en torno al uso de aplicaciones de IA en el momento de la interacción.

Bloquee a los atacantes oportunistas que intentan aprovechar la creciente popularidad de las aplicaciones de inteligencia artificial bloqueando dominios y URL maliciosos conocidos e inspeccionando todo el contenido HTTP y HTTPS.

→ Utilice la tecnología de aislamiento de navegador remoto (RBI) para brindar protección adicional cuando sea necesario visitar sitios web en categorías que pueden presentar un mayor riesgo, como dominios recién observados y registrados recientemente.

→ Asegúrese de que todas las defensas de seguridad compartan inteligencia y trabajen juntas para optimizar las operaciones de seguridad.

Los clientes de Netskope pueden usar Cloud Exchange para compartir IOC, importar información sobre amenazas, exportar registros de eventos, automatizar flujos de trabajo e intercambiar puntajes de riesgo.

Por Marcelo Lozano – General Publisher IT CONNECT LATAM

Lea más sobre Ciberseguridad en;

Malware en América Latina 2023: uso de aplicaciones en la nube como canal de distribución

SaaS 2023: Por qué la seguridad es un desafío

Robo de Identidad 2023: Kaspersky Alerta sobre Engaño Facial

DEF CON 31: hacking ético para proteger la IA

XWorm inyectado con Rust, Freeze[.]rs como amenaza emergente 2023

NO TE PIERDAS IT CONNECT SECURE STREAM