La brutal industrialización del Contenido Sintético desató en 2026 una crisis sistémica de veracidad, ciberseguridad y quiebre corporativo B2B en LATAM.

El ecosistema digital, empresarial y sociopolítico de América Latina ha colisionado con una pared de cristal en este mes de abril de 2026. Tras años de crecimiento sostenido y experimentación corporativa indiscriminada con inteligencia artificial generativa, la región enfrenta una disrupción sin precedentes históricos, catalizada casi en su totalidad por la hiperproducción y la industrialización del Contenido Sintético.

Esta crisis estructural no es meramente una coyuntura tecnológica de adaptación; es una crisis sistémica de veracidad, de modelos de negocio B2B, de infraestructura de ciberseguridad y de marcos regulatorios que han quedado de pronto dramáticamente obsoletos frente a la velocidad de iteración de los algoritmos de redes neuronales.

A medida que las organizaciones intentan navegar por esta tormenta perfecta, el Contenido Sintético se ha convertido, de forma simultánea y paradójica, en el vector de ataque más peligroso para la seguridad nacional y corporativa, y en el activo digital indispensable para la supervivencia comercial. La presente investigación desglosa con exhaustiva granularidad el panorama tecnológico, económico y legal de 2026, analizando el impacto devastador y transformador del Contenido Sintético en la industria de los medios de comunicación, el mercado publicitario, las finanzas, la legislación de propiedad intelectual y la resiliencia empresarial en la región de América Latina, con especial foco en las dinámicas del Cono Sur.

La Erosión Cognitiva de la Verdad y la Hegemonía del Contenido Sintético

La industria de los medios de comunicación y el espacio público digital atraviesan una crisis de veracidad que amenaza con socavar los cimientos de la confianza ciudadana y la estabilidad democrática.

De acuerdo con el informe anual “The Future 100: 2026” elaborado por la consultora VML Intelligence, la generalización y democratización de herramientas de inteligencia artificial de código abierto ha multiplicado de forma exponencial la producción de Contenido Sintético, alterando de forma irreversible la capacidad cognitiva del público para distinguir entre material periodístico legítimo y fabricaciones algorítmicas.

El Contenido Sintético ya no es una novedad experimental confinada a laboratorios de investigación tecnológica; es una industria pesada, completamente industrializada, que inunda las redes sociales, los portales informativos de nicho y los canales de comunicación corporativa con una fricción de producción cercana a cero.

Los datos duros revelan una fractura cognitiva severa en la audiencia global y regional. El 71% de los ciudadanos encuestados considera que la inteligencia artificial está haciendo literalmente imposible comprender qué es verdadero en el entorno digital, y un alarmante 81% afirma que la verdad, entendida como un concepto social compartido, se encuentra bajo amenaza directa y existencial.

Esta erosión de la confianza se retroalimenta diariamente por la disponibilidad de herramientas generativas hiperrealistas, capaces de producir imágenes, clones de voz y vídeos en fracciones de segundo. Estos sistemas permiten a actores maliciosos, agencias de desinformación y estafadores imitar fuentes de autoridad periodística o institucional sin necesidad de conocimientos técnicos avanzados, inundando el ecosistema con Contenido Sintético malicioso.

La crisis profunda del Contenido Sintético ha desdibujado la frontera entre la creación humana fundamentada y la automatización alucinada, generando una saturación informativa tóxica que penaliza gravemente al periodismo tradicional basado en la verificación, el trabajo de campo y el contraste de datos.

Frente a esta avalancha incontrolable de Contenido Sintético, las plataformas tecnológicas, los consorcios editoriales y los medios tradicionales han comenzado a ensayar respuestas estratégicas de contención. Surge con inusitada fuerza el concepto de “Truth Literacy” (Alfabetización de la Verdad), un paradigma educativo de emergencia diseñado para dotar a los consumidores de herramientas críticas cognitivas que les permitan decodificar narrativas audiovisuales manipuladas.

Simultáneamente, el mercado mediático asiste al despliegue urgente de sistemas de procedencia criptográfica liderados por la Coalition for Content Provenance and Authenticity (C2PA). Estos exigentes estándares técnicos de trazabilidad incrustan metadatos inalterables y firmas criptográficas en los archivos digitales desde el momento de su captura en el sensor de una cámara, para certificar de forma irrefutable si una pieza informativa es auténtica o si constituye, total o parcialmente, Contenido Sintético generado por IA.

Sin embargo, la adopción de estos protocolos en las redacciones de América Latina es dolorosamente incipiente y enfrenta severas resistencias operativas. Las empresas periodísticas debaten cómo integrar nuevos flujos de trabajo que diferencien las producciones puramente humanas del Contenido Sintético asistido sin paralizar la agilidad periodística en la mesa de redacción.

El uso extensivo y a veces irreflexivo de modelos de lenguaje masivo (LLMs) en las salas de redacción también está transformando el estilo editorial de forma subterránea. Términos, giros idiomáticos, adjetivaciones repetitivas y estructuras sintácticas características de los algoritmos se están infiltrando en artículos periodísticos y comunicaciones oficiales, diluyendo la identidad de marca de los medios y homogeneizando la prosa. A este fenómeno de contaminación algorítmica se suma el auge del “Algospeak”, un léxico codificado, opaco y altamente dinámico creado por los propios usuarios de plataformas para evadir la moderación automática de las redes sociales.

Esto introduce capas adicionales de complejidad en la cobertura de temas sensibles como la salud mental, la radicalización política o la violencia, donde los términos reales son reemplazados por eufemismos para eludir el filtrado de Contenido Sintético. En el año 2026, el valor comercial y democrático diferencial del periodismo ya no radica en la velocidad o la primicia, sino en la autoría humana certificada, la curaduría experta transparente y la capacidad tecnológica de demostrar la procedencia del dato frente al infinito océano de Contenido Sintético.

Sobrevivir a la Recesión B2B: GEO, AEO y la Trampa del Contenido Sintético Corporativo

Para las empresas del segmento B2B (Business-to-Business) en América Latina, el año 2026 está marcado a fuego por una profunda reconfiguración estratégica impulsada por la contracción macroeconómica. En un contexto de estancamiento regional, donde mercados clave como el mexicano apenas registraron un crecimiento del 0.3% en 2025 y el 35.6% de los CEOs globales operan bajo el temor de una recesión prolongada, la inteligencia artificial ha dejado de ser un proyecto piloto de innovación para convertirse en un imperativo de supervivencia operativa.

No obstante, la adopción impulsiva y carente de gobernanza ha generado vulnerabilidades críticas. El uso de Contenido Sintético en las interacciones comerciales B2B presenta riesgos reputacionales inmensos si no se gestiona con rigurosidad técnica y una arquitectura de datos blindada.

Uno de los mayores peligros documentados en este ciclo corporativo radica en la exposición de datos sensibles y la pérdida absoluta de control sobre la voz de la marca. La implementación precipitada de agentes conversacionales genéricos, alimentados con Contenido Sintético no supervisado y conectados a bases de datos en la nube sin salvaguardas, ha provocado incidentes corporativos severos.

Se han registrado múltiples casos donde sistemas de IA B2B se comprometen a fijar precios que no fueron autorizados por la gerencia, o explican erróneamente arquitecturas de servicios técnicos complejos a prospectos clave. En el intrincado ecosistema de ventas B2B, donde el ciclo de confianza es prolongado, técnico y altamente delicado, un solo intercambio fallido originado por Contenido Sintético alucinado puede costar la pérdida irreversible de contratos millonarios y dañar irreparablemente la confianza en el proveedor.

Para mitigar esta catástrofe operativa, las organizaciones tecnológicamente maduras están transitando aceleradamente hacia modelos operativos denominados “Bring Your Own Key” (BYOK). Esta arquitectura permite a las corporaciones conectar directamente sus interfaces internas con las APIs de los grandes modelos fundacionales de IA (tales como OpenAI, Anthropic o Google), garantizando que los datos corporativos de entrenamiento y el Contenido Sintético generado en las respuestas permanezcan encriptados y estrictamente confinados dentro de los perímetros de infraestructura de la empresa, evitando ceder márgenes y privacidad a vendedores intermediarios de software.

El paradigma de adquisición de clientes digitales también ha sufrido una mutación brutal que ha tomado por sorpresa a los departamentos de marketing convencionales. El SEO (Search Engine Optimization) tradicional se ha desmoronado como canal principal de captación ante la consolidación hegemónica de los motores de respuesta impulsados por inteligencia artificial generativa, como ChatGPT, Perplexity, Gemini y Google AI Overviews.

Las estadísticas de la industria indican que durante 2025, un asombroso 69% de las búsquedas en Google concluyeron sin generar un solo clic hacia enlaces externos (las llamadas zero-click searches). Los usuarios obtuvieron resoluciones directas e inmediatas a través de Contenido Sintético generado dinámicamente en la propia página de resultados.

Ante esta amenaza de invisibilidad digital, la supervivencia de las corporaciones latinoamericanas depende ahora de inversiones masivas en AEO (Answer Engine Optimization) y GEO (Generative Engine Optimization).

Las marcas deben estructurar el conocimiento interno de la empresa, implementar esquemas de marcado avanzados y generar respuestas de alta autoridad de tal forma que los modelos de lenguaje absorban esta información y la utilicen como fuente primaria verificada. El objetivo último del marketing en 2026 es que la propia marca sea citada textualmente dentro del Contenido Sintético que el motor generativo le devuelve al prospecto B2B.

La integración de agentes SDR (Sales Development Representative) impulsados íntegramente por IA es otra macrotendencia irreversible en el sector B2B. La métrica comercial del “speed-to-lead” dictamina históricamente que responder a un contacto entrante en menos de cinco minutos multiplica por cien la probabilidad de establecer una conexión efectiva.

Los SDR basados en Contenido Sintético, operando de manera ininterrumpida las 24 horas, asimilan consultas técnicas, califican leads mediante scoring dinámico y agendan reuniones sin ningún tipo de intervención humana inicial, permitiendo a las empresas reducir drásticamente sus costos fijos operativos.

No obstante, los analistas de Solumize advierten que el error corporativo más frecuente y destructivo de 2026 sigue siendo el intento ciego de reemplazar el juicio humano crítico con Contenido Sintético en las etapas finales de negociación de contratos complejos. En ese territorio definitivo de cierre de ventas, la empatía, la evaluación del riesgo contextual, la lectura del lenguaje no verbal y la construcción de relaciones de confianza a largo plazo resultan técnica y comercialmente insustituibles por cualquier algoritmo.

Finanzas y Retail: La Desintermediación y la Hemorragia de los 6 Billones de Dólares

El impacto económico de la adopción de inteligencia artificial y la proliferación del Contenido Sintético en los sectores productivos más tradicionales y fuertemente regulados ha alcanzado proporciones telúricas. A nivel global, la industria bancaria tradicional enfrenta proyecciones financieras devastadoras que amenazan su hegemonía centenaria.

Según análisis recientes, la manifiesta incapacidad de las instituciones bancarias legadas para competir con la agilidad de entidades nativas digitales, neobancos y ecosistemas fintech fuertemente apalancados en infraestructuras de IA podría costarles hasta el 35% de su participación de mercado hacia el final de la década en 2030. Esta pérdida proyectada de market share se traduce en una reducción astronómica de ingresos operativos calculada entre 5 y 6 billones de dólares.

En América Latina, esta dinámica de desintermediación financiera se ve acelerada a un ritmo vertiginoso por la adopción masiva e irreversible de billeteras virtuales y sistemas de pagos digitales descentralizados. Los nuevos competidores tecnológicos, al operar sin el lastre del mantenimiento de redes de sucursales físicas y al poseer un acceso omnicanal y granular a los datos transaccionales de los usuarios, despliegan motores de IA para ofrecer productos de crédito hiperpersonalizados, impulsados por interfaces de Contenido Sintético que educan y retienen al usuario de forma mucho más efectiva y económica que la banca tradicional.

Sin embargo, la madurez en la adopción corporativa de inteligencia artificial es profundamente desigual, fragmentada y asimétrica en la geografía latinoamericana. Mientras que la intención declarada de uso de IA supera holgadamente el 50% entre las grandes corporaciones de la región, la ejecución real de casos de uso operativos en producción es considerablemente menor.

El mapa de calor de la inversión tecnológica indica que Brasil y México concentran el grueso absoluto del despliegue de software, hardware y servicios de IA, dejando a economías relevantes como Argentina, Colombia, Perú y Chile inmersas en una frenética carrera de alcance tecnológico. En este escenario de competitividad darwiniana, el éxito empresarial no lo determina el mero volumen de Contenido Sintético generado en las áreas de marketing, sino la eficiencia matemática de los modelos predictivos y prescriptivos aplicados directamente al núcleo (core) del negocio.

En el sector de Servicios Financieros, que lidera de manera indiscutida la adopción corporativa en la región, las aplicaciones profundas de IA están logrando transformar la composición demográfica de la base de clientes. Los revolucionarios modelos de scoring crediticio alternativo, entrenados con vastas fuentes de datos no convencionales (comportamiento en redes, pagos de servicios, telemetría móvil), han permitido a las instituciones ampliar la base de clientes elegibles en poblaciones históricamente no bancarizadas entre un 15% y un 30%. Asimismo, el despliegue de agentes copilotos asistidos por Contenido Sintético para respaldar a los asesores comerciales humanos y la automatización inteligente del back office (procesamiento de documentos, conciliaciones) están logrando reducciones de costos operativos sin precedentes en la banca corporativa.

Por su parte, el sector de Retail y E-commerce, que ocupa el segundo lugar en el índice de madurez de IA, está utilizando motores analíticos avanzados para ejecutar estrategias implacables de pricing dinámico a nivel de SKU (Stock Keeping Unit), logrando mejoras sostenidas de margen neto de entre 1 y 3 puntos porcentuales en categorías altamente competitivas.

Al mismo tiempo, la hiperpersonalización predictiva del catálogo de productos y el despliegue de asistentes conversacionales hiperrealistas (basados en complejos grafos de Contenido Sintético avanzado) han redefinido por completo los estándares de retención en la posventa.

En marcado contraste, sectores fundamentales como la manufactura industrial y la salud privada enfrentan enormes barreras de integración debido a infraestructuras informáticas profundamente legadas, silos organizacionales y la ausencia crónica de arquitecturas de datos estructurados que permitan a los modelos aprender de forma continua.

El déficit estructural más grave que frena el potencial competitivo de LATAM se concentra, no obstante, en el capital humano. La escasez crónica de talento especializado en áreas de misión crítica como ingeniería de datos, Machine Learning y operaciones de modelos de lenguaje (MLOps) representa el cuello de botella más severo para las empresas de la región.

Los desarrolladores, ingenieros y científicos de datos locales migran de forma sostenida o prestan servicios bajo modalidades remotas a mercados del norte global, atraídos por compensaciones en divisa dura que las empresas latinoamericanas rara vez pueden igualar. Esto obliga a las corporaciones a recurrir a costosos servicios de staff augmentation premium para mantener operativos sus laboratorios de IA.

Además, persiste en las direcciones financieras de la región un error metodológico y contable de proporciones sistémicas: las empresas latinoamericanas continúan financiando presupuestariamente sus proyectos de IA y generación de Contenido Sintético como gastos de capital (CapEx) atados a un proyecto de despliegue único. Ignoran de manera flagrante que los modelos generativos contemporáneos y las canalizaciones de Contenido Sintético requieren, por su propia naturaleza estocástica, una inversión operativa continua (OpEx) para monitorización de rendimiento, reentrenamiento periódico con nuevos corpus de datos y mitigación de derivas algorítmicas (concept drift).

La Tormenta Perfecta de Ciberseguridad: Deepfakes, Contenido Sintético y Fraude Sistémico

El año 2026 quedará registrado en los anales de la tecnología corporativa como el periodo oscuro en el que el ciberfraude a escala industrial desplazó definitivamente al ransomware como la principal amenaza para la continuidad de los negocios a nivel mundial. El exhaustivo informe Panorama Global de Ciberseguridad 2026, publicado por el Foro Económico Mundial (WEF), establece inequívocamente que el riesgo cibernético se ha vuelto estructural y sistémico. Esta evolución letal se debe a la convergencia tóxica de la inteligencia artificial generativa, la creciente fragmentación geopolítica y la industrialización corporativa del fraude digital. En este complejo teatro de operaciones asimétricas, el Contenido Sintético actúa como la munición de precisión de los nuevos cárteles de ciberdelincuentes.

Las encuestas globales revelan que un apabullante 94% de los ejecutivos y líderes tecnológicos prevé que la inteligencia artificial será el principal motor de inestabilidad, disrupción y cambio en la disciplina de la ciberseguridad a lo largo de 2026. Sin embargo, la gran paradoja operativa de este ciclo es que el mayor temor corporativo no proviene exclusivamente de sofisticados ataques orquestados por estados nación o hackers externos.

El 34% de los líderes empresariales señala que su mayor preocupación de seguridad es la exposición accidental de bases de datos corporativas sensibles, filtradas a través del uso no regulado ni autorizado de herramientas generativas de Contenido Sintético por parte de sus propios empleados (fenómeno conocido como Shadow AI), superando el temor a las capacidades maliciosas ofensivas de la IA que preocupa al 29% de la muestra.

En el contexto geográfico de América Latina, la situación de ciberseguridad adquiere tintes dramáticos, exacerbados por una profunda e histórica crisis de confianza institucional. El documento del WEF evidencia una brecha regional abismal: apenas un exiguo 13% de los ejecutivos corporativos en América Latina y el Caribe confía en la preparación técnica y logística de su propio país frente a incidentes cibernéticos graves a escala de infraestructura crítica.

Esta es la cifra de confianza gubernamental más baja a nivel global, situándose en un doloroso contraste con el 84% de confianza registrado en regiones como Medio Oriente y el Norte de África. Esta desconfianza endémica es el reflejo directo de infraestructuras nacionales crónicamente subinvertidas y vulnerables, combinadas con un crecimiento verdaderamente exponencial de los ataques de ingeniería social.

El temido ataque de “Business Email Compromise” (BEC), que históricamente dependía de tácticas manuales, se ha metamorfoseado gracias a la automatización del Contenido Sintético. Los tradicionales correos de phishing masivos, detectables por sus traducciones rudimentarias y evidentes errores ortográficos, han desaparecido por completo.

En 2026, los estafadores utilizan infraestructuras de LLMs en la dark web para crear Contenido Sintético hiperpersonalizado a escala masiva, el cual imita a la perfección el tono de voz ejecutivo, la sintaxis corporativa, las referencias de proyectos internos y los hábitos comunicacionales específicos de CEOs, proveedores y gerentes financieros.

Estas operaciones psicológicas logran eludir consistentemente las defensas biométricas y engañar a empleados con acceso privilegiado en momentos inducidos de alta presión operativa, forzándolos mediante ingeniería social a autorizar transferencias bancarias millonarias hacia redes de cuentas mulas fraudulentas.

No obstante el impacto corporativo, el ataque más devastador para el tejido social base es, sin lugar a dudas, la clonación generativa de voz. Utilizando ínfimas muestras de audio extraídas de videos públicos en plataformas de redes sociales, las redes criminales organizadas generan Contenido Sintético vocal en tiempo real para perpetrar secuestros virtuales y fraudes de auxilio económico.

En la República Argentina, la alarmante vulnerabilidad de la población frente a estas sofisticadas tácticas ha desencadenado respuestas de emergencia desde la administración pública.

Como medida defensiva directa, se ha promulgado legislación en provincias clave, destacando el marco normativo de la provincia de Buenos Aires, diseñado explícitamente para exigir a las entidades bancarias la asunción de un rol activo, punible y obligatorio en la concienciación y protección digital de los adultos mayores.

Este segmento demográfico ha sido sistemáticamente victimizado, convirtiéndose en el blanco principal de estafas telefónicas y digitales donde el Contenido Sintético se utiliza para simular secuestros de familiares con un realismo emocional espeluznante.

La asimetría del conflicto es brutal: mientras las instituciones financieras se ven obligadas a invertir millones en herramientas predictivas para detectar anomalías, las células criminales operan modelos de Contenido Sintético de código abierto con costos marginales tendientes a cero. A nivel macro, el WEF estipula que un ciberataque significativo respaldado por estas tecnologías supone un costo directo promedio de 250,000 dólares por organización, un golpe letal para la resiliencia de la pequeña y mediana empresa latinoamericana.

La Frontera Regulatoria y la Propiedad Intelectual: Análisis de la Ley Turing en Argentina

La disrupción económica, ética y cultural provocada por el incesante alud de Contenido Sintético ha forzado a los parlamentos latinoamericanos a abandonar su letargo y ensayar respuestas legislativas improvisadas frente a tecnologías que evolucionan a ritmos que desafían los tiempos parlamentarios tradicionales.

El caso de estudio más prominente, controvertido y analizado durante abril de 2026 en toda la región es la iniciativa impulsada en la República Argentina: el proyecto legislativo 1013-D-2024, que transita su debate en el Congreso y ha sido bautizado mediáticamente como la “Ley Turing”. Este ambicioso proyecto de ley, redactado y presentado por el diputado nacional Oscar Agost Carreño con el respaldo de diversos bloques políticos, no busca implementar parches regulatorios aislados, sino que pretende ejecutar una readecuación sistémica e integral del marco legal argentino ante el impacto arrollador de la inteligencia artificial, estableciendo un precedente jurisprudencial que está siendo monitoreado meticulosamente por cancillerías y bufetes jurídicos en todo el continente.

El núcleo dogmático y la propuesta más radical de la Ley Turing aborda de manera frontal la escurridiza naturaleza jurídica de los outputs algorítmicos, proponiendo introducir modificaciones históricas a los artículos centrales de la Ley 11.723, el régimen legal de Propiedad Intelectual que rige en Argentina.

El texto legislativo en debate propone establecer una categorización ontológica y binaria revolucionaria. Por un lado, el proyecto define rigurosamente las denominadas “producciones asistidas”. Estas abarcan aquellas creaciones intelectuales donde existe una colaboración técnica demostrable entre el intelecto humano directivo y las herramientas generativas subordinadas.

En estos escenarios híbridos, la protección de los derechos de autor recaerá, de forma exclusiva y excluyente, sobre la porción específica de la obra que sea innegablemente producto del intelecto humano. En caso de litigio donde resulte técnicamente imposible diseccionar la intervención de la máquina de la del humano, la legislación delega la resolución final al arbitrio del sistema judicial.

Por otro lado, y aquí yace la disrupción absoluta, la ley tipifica legalmente las “producciones sintéticas”, refiriéndose al Contenido Sintético generado en su práctica totalidad por modelos algorítmicos, carente de una intervención humana creativa sustancial y estructurada. Según el articulado explícito del proyecto, este Contenido Sintético puro carece ab initio de titularidad humana y, en consecuencia, queda excluido de manera tajante de cualquier tipo de protección bajo la normativa nacional de propiedad intelectual.

Las profundas implicaciones económicas de este andamiaje jurídico para las agencias de marketing digital, los estudios de diseño gráfico, las productoras audiovisuales y los laboratorios desarrolladores de software en Argentina son incalculables.

Las corporaciones B2B que, en aras de la reducción de costos, han comenzado a externalizar la creación de sus campañas publicitarias basándose íntegramente en la proliferación de Contenido Sintético corren el riesgo inminente de no poder registrar, blindar, ni proteger comercialmente sus cuantiosos activos digitales. Más aún, si el Contenido Sintético empresarial llegara a violar de forma indirecta los derechos patrimoniales de obras de autoría humana preexistentes —mediante mecanismos técnicos de scraping indebido, ingestión no autorizada de datos de entrenamiento o clonación paramétrica de estilos artísticos—, los autores originales se verán investidos por la ley con la potestad civil de iniciar acciones legales y reclamos de resarcimiento directo contra los comercializadores corporativos de dicho contenido.

La ambición de la Ley Turing trasciende el ámbito del copyright y se adentra de lleno en la salvaguarda de los derechos personalísimos, proponiendo modificaciones de fondo al Código Civil y Comercial de la Nación (mediante la incorporación del polémico Artículo 53 Bis). Esta modificación consagra la obligatoriedad jurídica de obtener el consentimiento previo, expreso y documentado de cualquier ciudadano para la producción, alteración y difusión pública de material audiovisual sintético basado en sus rasgos biométricos, extendiendo formalmente la protección legal a la imagen y consagrando el “registro vocal” como un bien jurídico tutelado frente al uso no autorizado de clones de voz generados por IA.

Simultáneamente, el cuerpo normativo interviene de urgencia el Código Penal argentino (reformando y derogando artículos previos) para tipificar y castigar con severas penas de prisión la producción y diseminación de pornografía sintética (deepfakes de naturaleza sexual generados sin consentimiento).

El proyecto establece penas de prisión de 3 meses a 1 año, pero prevé agravantes drásticos que duplican la pena si el Contenido Sintético vulnera la integridad de menores de 18 años, o si es instrumentalizado por bandas criminales con fines de extorsión, acoso o difamación sistemática. Asimismo, la ley proyecta penas carcelarias de 3 a 6 años para aquellos desarrolladores que programen y distribuyan plataformas de software o repositorios de código cuya intención primaria y explícita sea la generación de estas representaciones sexuales no autorizadas.

Este intento de ordenamiento holístico en Argentina, con su enfoque humanista y restrictivo, contrasta vívidamente con la pronunciada fragmentación legislativa que impera en el resto del continente latinoamericano. Los reportes de análisis comparado de 2026 destacan realidades divergentes: mientras Panamá avanza a su propio ritmo hacia la modernización sectorial de su Ley de Propiedad Industrial y la República Dominicana concentra sus escasos recursos en reforzar el enforcement y la vigilancia física en las aduanas para combatir las infracciones digitales tangibles, México se esfuerza de manera prioritaria por armonizar su legislación interna a las estrictas exigencias de patentes del acuerdo comercial T-MEC.

Los juristas y consultores especializados de la región coinciden unánimemente en que, hacia finales del ejercicio comercial de 2026, la viabilidad y el éxito económico de los titulares de derechos de autor corporativos dependerá casi enteramente de su agilidad institucional para gestionar cadenas de custodia de pruebas electrónicas y auditar criptográficamente sus repositorios de datos masivos. El objetivo: diferenciar fehacientemente y ante los tribunales sus legítimas creaciones humanas del omnipresente Contenido Sintético exento de protección legal, navegando por un océano de regulaciones divergentes y mercados grises.

Democracia Hackeada: Desinformación, Violencia y Subversión Electoral

El año calendario 2026 configura un escenario de altísima tensión institucional en América Latina, al concentrar procesos electorales presidenciales, legislativos y regionales de carácter decisivo en polos geopolíticos como Brasil, Argentina y naciones andinas.

En este polvorín sociopolítico, el Contenido Sintético ha sido completamente militarizado y convertido en un arma estratégica asimétrica. Operadores políticos en la sombra, agencias transnacionales de desinformación por encargo, mercenarios digitales y actores geopolíticos con intereses en la región están utilizando estas herramientas algorítmicas con un objetivo cristalino: subvertir de manera encubierta la integridad de los procesos democráticos e influir decisivamente en la intención de voto.

Las sombrías lecciones extraídas de las convulsionadas elecciones municipales brasileñas de 2024 sirvieron, retrospectivamente, como un campo de pruebas y un perturbador preludio estratégico de la gigantesca crisis de desinformación que asola las urnas continentales en 2026.

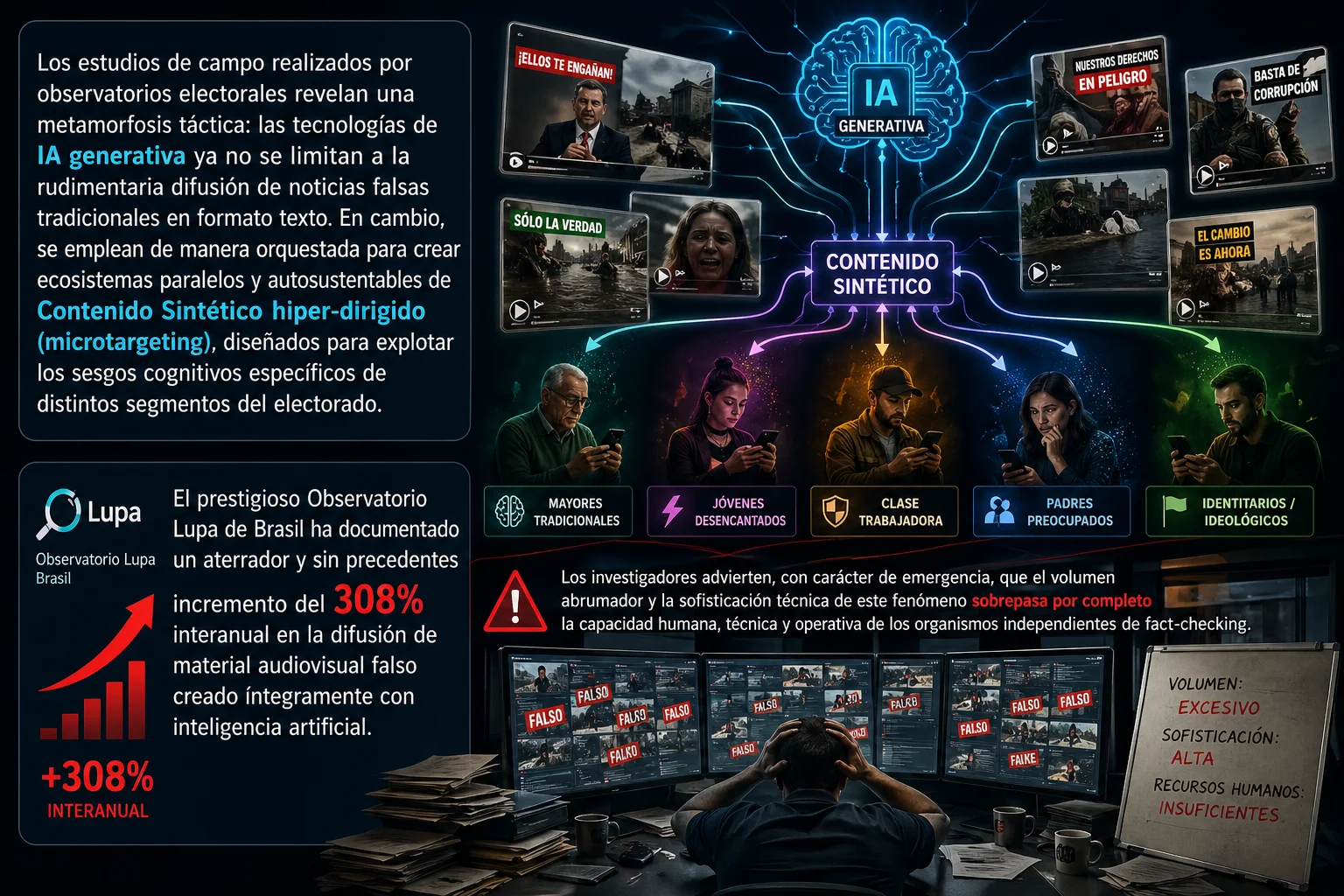

Los estudios de campo realizados por observatorios electorales revelan una metamorfosis táctica: las tecnologías de IA generativa ya no se limitan a la rudimentaria difusión de noticias falsas tradicionales en formato texto. En cambio, se emplean de manera orquestada para crear ecosistemas paralelos y autosustentables de Contenido Sintético hiper-dirigido (microtargeting), diseñados para explotar los sesgos cognitivos específicos de distintos segmentos del electorado.

El prestigioso Observatorio Lupa de Brasil ha documentado un aterrador y sin precedentes incremento del 308% interanual en la difusión de material audiovisual falso creado íntegramente con inteligencia artificial. Los investigadores advierten, con carácter de emergencia, que el volumen abrumador y la sofisticación técnica de este fenómeno sobrepasa por completo la capacidad humana, técnica y operativa de los organismos independientes de fact-checking.

Un caso paradigmático que expuso la fragilidad cognitiva del electorado ocurrió a través de la plataforma TikTok, donde se utilizó un enjambre de herramientas algorítmicas para generar videos virales. En estos montajes, presentadores de noticias sintéticos de apariencia intachable (deepfakes generados a partir del robo de rostros de periodistas reales) anunciaban desde supuestos estudios televisivos el inminente brote de virus letales inexistentes. El Contenido Sintético, editado magistralmente para emular zócalos, iluminación y cadencia de transmisiones periodísticas tradicionales, indujo un pánico poblacional genuino en vísperas de festividades nacionales, demostrando la pavorosa facilidad con la que la IA puede manipular la agenda pública y el comportamiento de las masas en tiempo real.

La violencia política, un flagelo endémico en la región, también ha encontrado un amplificador implacable y automatizado en la masificación del Contenido Sintético. Los informes de observadores regionales y de la iniciativa IDEA Internacional demuestran contundentemente que las candidatas femeninas y los miembros de comunidades LGBTQIA+ que participan en la contienda electoral son desproporcionadamente objeto de ataques difamatorios, acoso coordinado y escarnio público.

Estas campañas destructivas son orquestadas velozmente mediante la viralización de deepfakes denigratorios y material íntimo fabricado sintéticamente. La arquitectura perversa de estos ataques no busca únicamente aniquilar la reputación personal del oponente político, sino que tiene un propósito más siniestro: sembrar el cinismo cívico absoluto, apelando al temor paralizante y a las emociones primarias de la población para lesionar la confianza ciudadana en la veracidad institucional y en la legitimidad del sistema representativo mismo.

Para los máximos organismos electorales del continente, en particular la Cámara Nacional Electoral (CNE) de la República Argentina y el Tribunal Superior Electoral (TSE) de Brasil, el combate directo contra la proliferación de Contenido Sintético malicioso ha impuesto la necesidad apremiante de forjar alianzas tácticas e intercambiar inteligencia continental.

Las estrategias de contención de estos tribunales ya no se basan únicamente en el mecanismo del desmentido oficial tradicional, el cual ha demostrado ser ineficaz al llegar sistemáticamente tarde respecto a la propagación algorítmica y la viralidad exponencial del Contenido Sintético.

La nueva doctrina electoral de 2026 exige la firma de acuerdos coercitivos y de responsabilidad legal compartida con las gigantes corporaciones tecnológicas dueñas de las redes sociales. El objetivo es imponer la marcación criptográfica obligatoria, la degradación punitiva en la visibilidad del algoritmo (shadowbanning) y la eventual eliminación proactiva de deepfakes y Contenido Sintético que constituyan amenazas verificables para la seguridad nacional y la paz social durante el proceso de escrutinio.

El Ecosistema Tecnológico de Buenos Aires: El Gran Distrito de la Inteligencia Artificial

Frente a la disrupción económica global y la reconfiguración de las cadenas de valor que ha provocado la inteligencia artificial, las administraciones locales y los gobiernos municipales en América Latina buscan desesperadamente posicionar a sus ciudades como epicentros de la nueva economía del conocimiento. En este competitivo escenario de reordenamiento geopolítico tecnológico, el Gobierno de la Ciudad Autónoma de Buenos Aires ha decidido dar un paso al frente lanzando, en marzo de 2026, una ambiciosa iniciativa estructural: la creación legal y territorial del gran Distrito de Inteligencia Artificial en el corazón geográfico del histórico Microcentro porteño.

El vasto proyecto, impulsado y defendido políticamente por el Jefe de Gobierno porteño, Jorge Macri, no debe ser interpretado como una simple y cosmética rezonificación urbana; se trata de un intento estratégico de altísimo perfil para capitalizar económicamente el innegable boom del Contenido Sintético y el desarrollo algorítmico.

La meta es transformar un área que históricamente funcionó como el indiscutido corazón financiero, administrativo y cultural de la nación (delimitada espacialmente por las icónicas avenidas Corrientes, Santa Fe, Córdoba y la amplia 9 de Julio) en el hub tecnológico preeminente e ineludible de toda América Latina.

Allí donde, tras el éxodo post-pandémico y la consolidación del trabajo remoto, abundaban imponentes edificios corporativos vacíos y persianas comerciales bajas, el plan maestro contempla la radicación intensiva de laboratorios de innovación disruptiva, incubadoras de startups enfocadas en soluciones B2B, y centros de investigación académica especializados en ciencia de datos, automatización, procesamiento masivo de lenguaje natural y robótica avanzada.

Para vencer la pesada inercia económica característica de la región y lograr atraer de forma efectiva a corporaciones del calibre planetario de Amazon Web Services (AWS), Microsoft, Meta, Oracle e IBM, así como a unicornios locales como Globant, el proyecto de ley ha diseñado y puesto sobre la mesa un paquete de incentivos financieros y tributarios inusualmente agresivo para los estándares impositivos argentinos.

Las empresas centradas en la investigación, generación, gestión e infraestructura de inteligencia artificial y Contenido Sintético que decidan instalarse legal y físicamente dentro de este estricto perímetro gozarán de beneficios sustanciales a largo plazo.

Entre estos se incluyen la exención o reducción drástica del pago del asfixiante Impuesto sobre los Ingresos Brutos, la anulación del Impuesto de Sellos en contratos comerciales, y considerables alivios en el impuesto inmobiliario (ABL) y en los engorrosos derechos de obra y construcción.

Adicionalmente al blindaje fiscal, el entramado se complementa con un potente esquema de apalancamiento crediticio canalizado a través del Banco Ciudad, el cual se compromete a proveer a las empresas tecnológicas radicadas financiamiento estratégico con tasas reales altamente preferenciales (en torno al 8,5% anual), extendiendo plazos de amortización de hasta 20 años y ofreciendo la inusual posibilidad de financiar hasta el 75% del valor de adquisición de inmuebles destinados a la reconversión y actualización tecnológica de los espacios.

Uno de los pilares jurídicos y operativos más innovadores e internacionalmente observados del Distrito IA porteño es la implementación pionera en el país de un modelo de “sandbox regulatorio”. Este audaz marco legal de pruebas, operando bajo condiciones de extrema flexibilidad pero riguroso monitoreo, permitirá a las empresas tecnológicas, instituciones de investigación y startups experimentar y desplegar en entornos urbanos reales (calles y avenidas del microcentro) tecnologías fronterizas.

Entre ellas se cuentan algoritmos de conducción autónoma urbana, biometría espacial, drones de logística y la ingestión de datos para entrenar modelos masivos generadores de Contenido Sintético. Todo esto, operando bajo dispensas jurídicas temporales y excepcionales que los eximen de cumplir con regulaciones locales rígidas y burocráticas que, tradicionalmente, ahogan e inhiben la innovación disruptiva en las etapas tempranas de I+D.

Este progresista modelo de incubación regulatoria busca, de manera decidida, posicionar a Buenos Aires en la vanguardia absoluta de la región, funcionando como un faro para atraer talento especializado internacional y, más importante aún, mitigar la endémica fuga de cerebros (el cual hemos analizado como el principal obstáculo B2B regional) mediante la creación de una sinergia intensiva, coordinada y provechosa entre el músculo financiero del sector privado, el rigor metodológico del sector académico universitario y la facilitación proactiva de las políticas públicas del Estado.

La aspiración de máxima, el objetivo ulterior a largo plazo que delinean los funcionarios a cargo del proyecto del distrito tecnológico, es sentar sólidamente las bases de infraestructura de fibra oscura, hiperconectividad, refrigeración e inversión en capital de riesgo necesarias para poder albergar en la ciudad una computadora cuántica funcional a nivel comercial. Este sería un hito de soberanía tecnológica sin precedentes fuera de potencias hegemónicas como Estados Unidos, China o Suiza, representando un salto exponencial en las capacidades de cómputo del Cono Sur.

La Metamorfosis Publicitaria y las Profundas Controversias Lingüísticas en la Era del GEA

La lógica conceptual del marketing estratégico y la arquitectura de distribución del inmenso mercado publicitario han mutado de manera irreversible durante los últimos veinticuatro meses. El año 2026 marca el desplome definitivo y el obsoleto ocaso de los paradigmas publicitarios basados tradicionalmente en la captura estática de la demanda existente a través de buscadores indexados. En su reemplazo, emerge arrolladora y como fuerza mercantil dominante el Generative Engine Advertising (GEA). Esta nueva y sofisticada metodología programática consiste en insertar y entrelazar dinámicamente formatos publicitarios nativos directamente dentro de las respuestas conversacionales fluidas y el Contenido Sintético hiperpersonalizado que las grandes inteligencias artificiales entregan al usuario final.

El intrincado proceso de búsqueda y la posterior decisión de compra del consumidor contemporáneo, operando tanto en entornos de consumo masivo B2C como en complejas adquisiciones B2B, se ha alargado y, sobre todo, se ha hiperfragmentado de una manera que desconcierta a los analistas de medios tradicionales.

Al recurrir casi por reflejo a agentes conversacionales y asistentes virtuales dotados de IA como primera y principal fuente de consulta y descubrimiento, la capacidad de influencia temprana de una marca depende de manera exclusiva y excluyente de que sus datos corporativos, sus ventajas competitivas y sus mensajes comerciales formen parte integral y orgánica del propio Contenido Sintético formativo que la máquina procesa, sintetiza y le devuelve estructurado al usuario.

El implacable paradigma del GEA impone como mandato ineludible que las marcas optimicen exhaustivamente sus narrativas institucionales para ser procesadas, digeridas y posteriormente recomendadas orgánicamente por modelos fundacionales como la familia GPT de OpenAI o el ecosistema Gemini de Google. Esto provoca en tiempo real el desplazamiento masivo de presupuestos de inversión publicitaria desde el “Search” tradicional hacia nuevas tácticas envolventes que combinan estratégicamente la generación de Contenido Sintético con pautas programáticas inmersivas en redes sociales y entornos de video.

De manera paralela y sinérgica a esta silenciosa revolución digital en pantallas individuales, el entorno físico y la infraestructura publicitaria urbana (conocida como Out of Home – OOH) en toda América Latina experimenta una hiper-tecnologización que la proyecta a superar holgadamente la barrera de los 1.000 millones de dólares estadounidenses en facturación consolidada para finales del ejercicio 2026.

En metrópolis de escala global como Buenos Aires, San Pablo o Ciudad de México, la publicidad exterior tradicional de papel y vinilo ha sido erradicada en zonas premium y reemplazada por redes digitalizadas de alta definición.

La amalgama de la inteligencia artificial, las redes IoT (Internet de las Cosas) y el aprendizaje automático predictivo permiten ahora a los grandes planificadores de medios (media planners) utilizar masivas cantidades de datos de movilidad poblacional en tiempo real.

Estos datos, triangulados con información meteorológica y de consumo, se usan para modificar instantáneamente creatividades estáticas, reemplazándolas por Contenido Sintético altamente modular, dinámico y contextualmente relevante.

Un monumental panel publicitario LED ubicado en la vía pública o en una autopista de alto tránsito ahora ajusta su mensaje visual, su paleta de colores y su texto promocional (copy) en fracciones de microsegundo.

Adapta la narrativa algorítmicamente y de forma predictiva en función del perfil sociodemográfico estimado de los transeúntes vehiculares o peatonales detectados en un rango geográfico perimetral, de las inclemencias del clima, del momento específico del día o de las tendencias de conversación social latentes en esa franja horaria precisa.

Todo este proceso ocurre mediante la generación automatizada de Contenido Sintético que fusiona arte publicitario con precisión algorítmica sin requerir intervención humana directa en la pauta.

Sin embargo, a pesar de los asombrosos avances en distribución programática, la adopción y penetración comercial efectiva de los grandes modelos de lenguaje en la región latinoamericana se enfrenta a un desafío estructural gigantesco, arraigado en los estratos más profundos del ámbito semántico, sociolingüístico y cultural.

La homogeneización forzada del lenguaje es un daño colateral y un riesgo reputacional inherente al entrenamiento globalizado de modelos de IA. Investigaciones filológicas e informáticas de vanguardia publicadas recientemente en la plataforma científica Arxiv han demostrado fehacientemente que, a pesar de sus innegables e impresionantes capacidades de razonamiento analítico, los LLMs comerciales de mayor uso exhiben sesgos de entrenamiento marcadísimos. Además, muestran un rendimiento severamente desigual y deficiente cuando se los somete a evaluar y producir la vasta riqueza de las variaciones diatópicas del idioma español, hablado por más de quinientos millones de personas.

Cuando modelos avanzados de diversas corporaciones tecnológicas son evaluados bajo estrictas pruebas de respuesta múltiple para identificar peculiaridades morfosintácticas, conjugaciones irregulares y léxicos específicos de uso corriente, demuestran una fuerte, casi exclusiva inclinación y mejor comprensión hacia el español peninsular (hablado en España).

Por el contrario, fracasan de manera estruendosa y recurrente al intentar capturar, reproducir o interpretar las innegables sutilezas idiomáticas, modismos y construcciones gramaticales propias de dialectos regionales vitales como el rioplatense (Argentina y Uruguay), el andino, el antillano o el caribeño continental. Los estudios concluyen de manera tajante que, en el actual escenario del año 2026, de todos los competidores en el mercado de la IA generativa, únicamente arquitecturas hipermasivas con parámetros de entrenamiento extremadamente diversificados como GPT-4o logran identificar, discernir y emular de manera consistentemente fidedigna y natural la infinita variabilidad de la lengua española.

Para las direcciones de marketing corporativo del sector B2B, y especialmente para los estrategas de campañas hiperlocales B2C desplegadas en territorios como Argentina, Uruguay o Chile, esta deficiencia técnica representa un talón de Aquiles comercial.

La utilización negligente de modelos lingüísticos genéricos o de arquitecturas menores para la generación automatizada y a gran escala de Contenido Sintético publicitario o textos de atención al cliente resulta, invariablemente, en la producción de comunicaciones corporativas que son inmediatamente percibidas por el público local como exógenas, neutras en exceso, plásticas o directamente artificiales.

Este desfase semántico daña severamente la afinidad cultural que la marca intenta construir pacientemente con su audiencia, destruye la ilusión de personalización que prometen las tecnologías de CRM, y perjudica, en última instancia, las métricas más sensibles del embudo de conversión comercial, evidenciando que la generación de Contenido Sintético no es simplemente un problema de potencia de cálculo informático, sino un intrincado y fascinante desafío de identidad cultural humana.

Por Marcelo Lozano – General Publisher IT CONNECT LATAM

Lea más sobre Análisis de datos e IA en;

- Agentes Autónomos de IA: van a cambiar tu trabajo de valor (y tu vida) en 2026

- Conectividad inteligente 2026: cómo la IA está transformando la infraestructuras IT

- CEO Invisible: cómo la IA 2026 asume el control digno de la estrategia

- CLAUDE MYTHOS 2026: seguridad automatizada

- Edwin Chen 1 alquimista digital en busca de la verdad y seguridad

Contenido Sintético, Contenido Sintético, Contenido Sintético, Contenido Sintético, Contenido Sintético, Contenido Sintético, Contenido Sintético, Contenido Sintético, Contenido Sintético, Contenido Sintético, Contenido Sintético, Contenido Sintético, Contenido Sintético, Contenido Sintético,